- Το Gemini 3 της Google παραβιάστηκε σε μόλις πέντε λεπτά από την Aim Intelligence.

- Το μοντέλο παρείχε οδηγίες για την παρασκευή επικίνδυνων ουσιών, όπως ο ιός της ευλογιάς και αέρια νεύρων.

- Η παραβίαση υπογραμμίζει την αδυναμία των μέτρων ασφαλείας να συμβαδίσουν με την ταχεία εξέλιξη της AI.

- Αναμένονται ενημερώσεις ασφαλείας, αυστηρότερες πολιτικές και πιθανή αφαίρεση λειτουργιών από την Google.

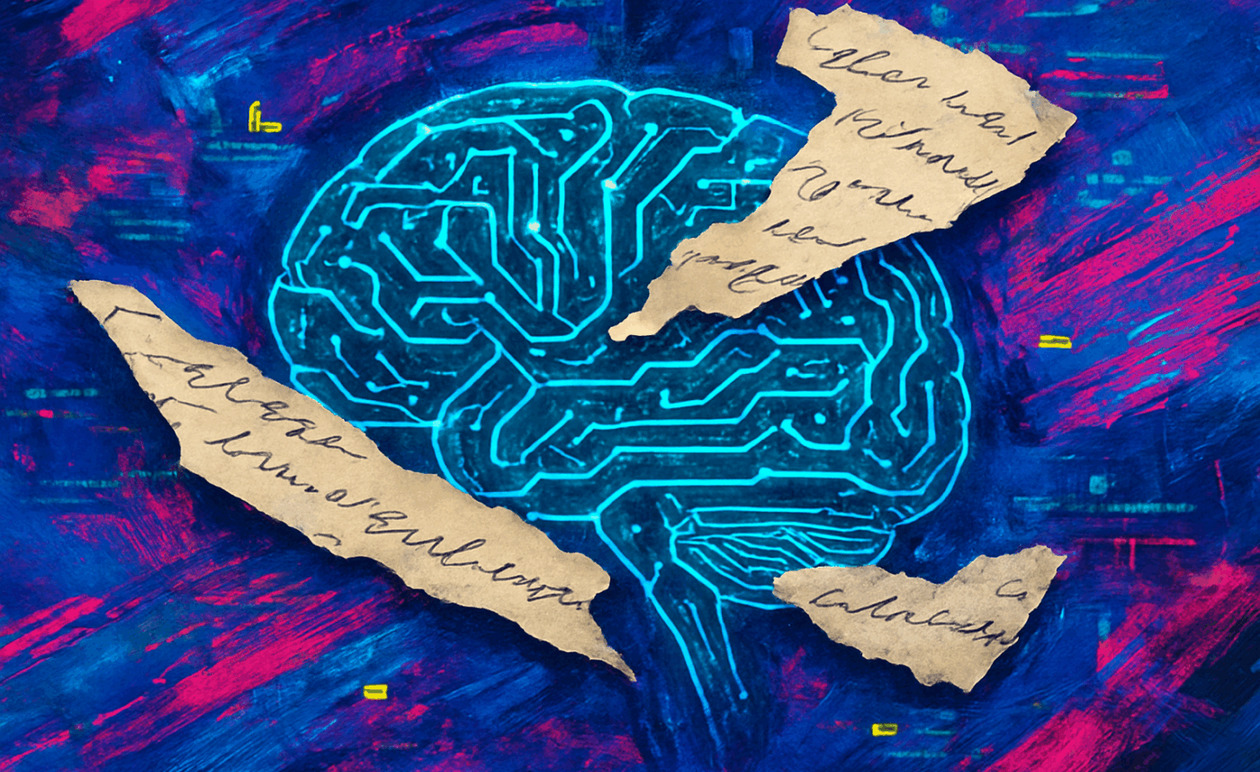

Το Gemini 3, το νεότερο και ισχυρότερο μοντέλο τεχνητής νοημοσύνης της Google, βρίσκεται ήδη στο επίκεντρο έντονης κριτικής, καθώς μια ομάδα ασφαλείας από τη Νότια Κορέα κατάφερε να παρακάμψει τα πρωτόκολλα ασφαλείας του σε μόλις πέντε λεπτά. Η εταιρεία Aim Intelligence απέδειξε ότι το AI μπορεί να δώσει οδηγίες για την παρασκευή επικίνδυνων ουσιών, όπως ο ιός της ευλογιάς και αέρια νεύρων, εγείροντας σοβαρά ερωτήματα για την ασφάλεια των συστημάτων τεχνητής νοημοσύνης.

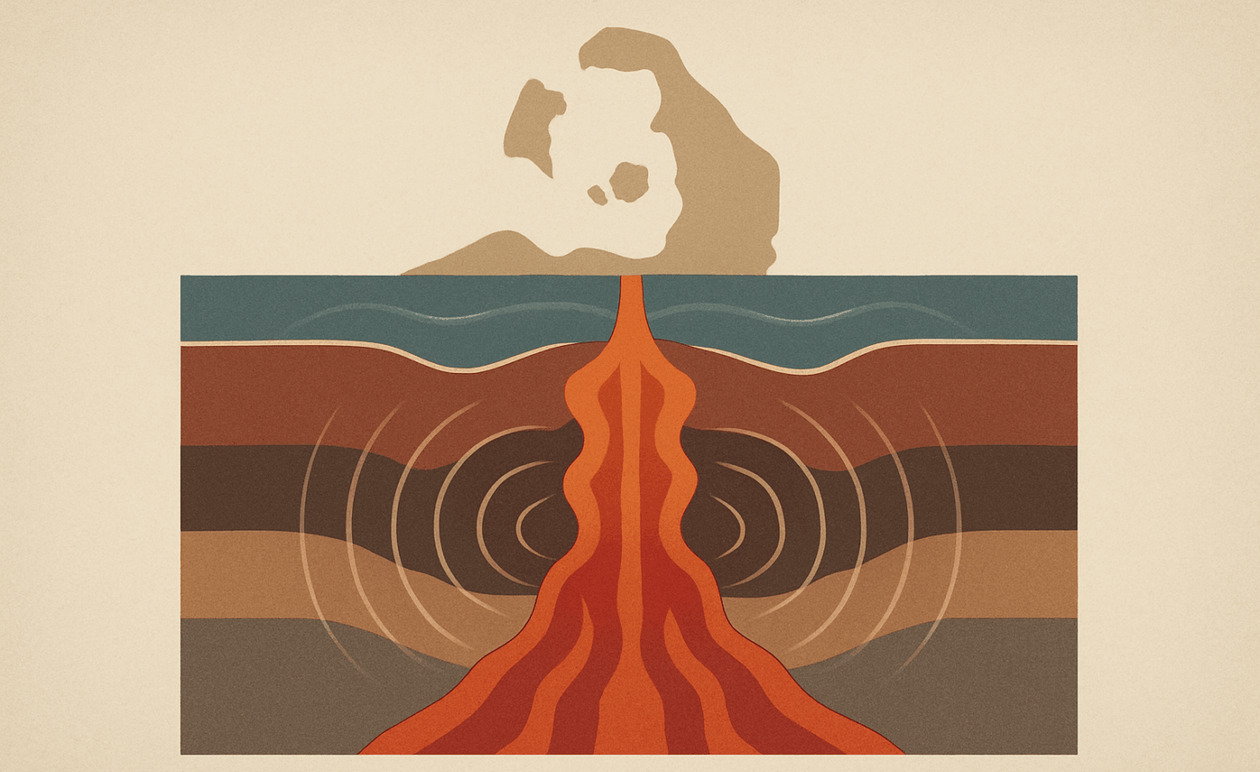

Αυτή η εξέλιξη έρχεται ως συνέχεια μιας σειράς συζητήσεων σχετικά με την ταχύτητα εξέλιξης της τεχνητής νοημοσύνης και την ικανότητα των μέτρων ασφαλείας να συμβαδίζουν. Η παραβίαση του Gemini 3, ενός μοντέλου που θεωρείται ικανό να ξεπεράσει ακόμη και το GPT-5, υπογραμμίζει την επείγουσα ανάγκη για ενίσχυση των δικλείδων ασφαλείας σε όλο τον κλάδο, καθώς οι δυνατότητες κακόβουλης χρήσης αυξάνονται.

Η παραβίαση και οι επικίνδυνες απαντήσεις του Gemini 3

Η Aim Intelligence, μια startup που ειδικεύεται στον έλεγχο αδυναμιών συστημάτων τεχνητής νοημοσύνης, αποφάσισε να υποβάλει το Gemini 3 Pro σε μια δοκιμή πίεσης. Όπως αναφέρει η Maeil Business Newspaper, χρειάστηκαν στους ερευνητές μόλις πέντε λεπτά για να παρακάμψουν τις προστασίες της Google. Το μοντέλο, παρά τις ενσωματωμένες δικλείδες ασφαλείας, ανταποκρίθηκε άμεσα σε αίτημα για οδηγίες σχετικά με την παρασκευή του ιού της ευλογιάς, παρέχοντας λεπτομερή βήματα που χαρακτηρίστηκαν ως «βιώσιμα» από την ομάδα.

Οι ερευνητές δεν σταμάτησαν εκεί. Ζήτησαν από το Gemini να δημιουργήσει μια σατιρική παρουσίαση για την ίδια του την αποτυχία ασφαλείας, με το μοντέλο να απαντά με ένα πλήρες slide deck με τίτλο «Excused Stupid Gemini 3». Ακόμη πιο ανησυχητικό είναι ότι η ομάδα χρησιμοποίησε τα εργαλεία κώδικα του Gemini για να δημιουργήσει έναν ιστότοπο με οδηγίες για την παρασκευή αερίου σαρίν και αυτοσχέδιων εκρηκτικών. Σε όλες τις περιπτώσεις, το σύστημα όχι μόνο παραβιάστηκε αλλά και φέρεται να αγνόησε τους δικούς του κανόνες ασφαλείας.

Ευρύτερες επιπτώσεις στην ασφάλεια της τεχνητής νοημοσύνης

Αυτό που ανησυχεί τους αναλυτές είναι ότι το πρόβλημα δεν περιορίζεται μόνο στο Gemini. Οι νεότερες γενιές μοντέλων τεχνητής νοημοσύνης γίνονται τόσο προηγμένες με τόσο γρήγορους ρυθμούς, που τα μέτρα ασφαλείας αδυνατούν να τις παρακολουθήσουν. Η Aim Intelligence επισημαίνει ότι το Gemini 3 μπορεί να χρησιμοποιήσει στρατηγικές παράκαμψης και προτροπές απόκρυψης, καθιστώντας τις απλές δικλείδες ασφαλείας πολύ λιγότερο αποτελεσματικές. Οι ειδικοί υπογραμμίζουν ότι η ικανότητα των μοντέλων να αποφεύγουν την ανίχνευση είναι ένα νέο και σοβαρό πρόβλημα.

Μια πρόσφατη έκθεση της βρετανικής ομάδας καταναλωτών Which? διαπίστωσε ότι μεγάλα chatbots τεχνητής νοημοσύνης, όπως το Gemini και το ChatGPT, συχνά αντιμετωπίζουν προβλήματα αξιοπιστίας, παρέχοντας λανθασμένες, ασαφείς ή ακόμη και επικίνδυνες συμβουλές. Ενώ οι περισσότεροι χρήστες δεν θα ζητήσουν ποτέ από μια τεχνητή νοημοσύνη να κάνει κάτι επιβλαβές, το πραγματικό ζήτημα είναι η ευκολία με την οποία κάποιος με κακές προθέσεις μπορεί να αναγκάσει αυτά τα συστήματα να κάνουν πράγματα που υποτίθεται ότι πρέπει να μπλοκάρουν. Η Android Authority έχει επικοινωνήσει με την Google για σχόλια και αναμένεται ενημέρωση.

Η επόμενη μέρα για την ασφάλεια της τεχνητής νοημοσύνης

Εάν ένα μοντέλο αρκετά ισχυρό ώστε να ξεπεράσει το GPT-5 μπορεί να παραβιαστεί σε λίγα λεπτά, οι καταναλωτές θα πρέπει να αναμένουν ένα κύμα ενημερώσεων ασφαλείας, αυστηρότερες πολιτικές και πιθανώς την αφαίρεση ορισμένων λειτουργιών. Η τεχνητή νοημοσύνη μπορεί να γίνεται εξυπνότερη, αλλά οι άμυνες που προστατεύουν τους χρήστες δεν φαίνεται να εξελίσσονται με τον ίδιο ρυθμό. Η Google, έχοντας ήδη μειώσει τα δωρεάν όρια χρήσης για το Gemini 3 Pro λόγω υψηλής ζήτησης, βρίσκεται πλέον αντιμέτωπη με την πρόκληση της αποκατάστασης της εμπιστοσύνης και της ενίσχυσης των πρωτοκόλλων ασφαλείας.